OpenClaw 思考与 PineClaw 产品实践

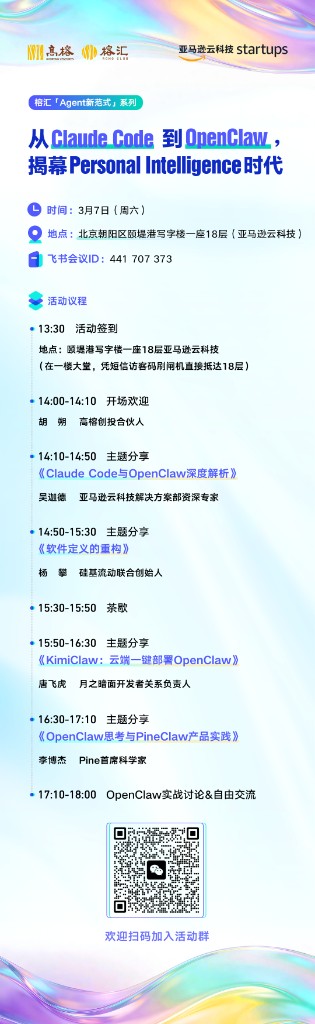

(本文整理自 2026 年 3 月 7 日高榕榕汇「Agent 新范式」系列活动的现场分享)

2026 年 3 月 7 日,高榕榕汇「Agent 新范式」系列活动在北京亚马逊云科技举办,主题为「从 Claude Code 到 OpenClaw,揭幕 Personal Intelligence 时代」。活动邀请了来自亚马逊云科技、硅基流动、月之暗面、Pine AI 等团队的嘉宾,围绕 OpenClaw 生态进行深度分享。我作为最后一位分享嘉宾,做了题为《OpenClaw 思考与 PineClaw 产品实践》的演讲。

这次分享分为两个部分。第一部分是关于 OpenClaw 的思考——OpenClaw 给 AI Agent 领域带来的启发与局限;第二部分是 PineClaw 的产品实践——Pine AI 是什么,以及如何将能力开放给 OpenClaw 生态。

第一部分:OpenClaw 的思考

主权智能体:自由与责任的重新定义

OpenClaw 之所以能火起来,我认为有两个核心原因。

第一是丰富的 Connector。 OpenClaw 可以通过各种各样的渠道来控制它——Telegram、iMessage、WhatsApp 等等,只要连上对应的 channel,就可以给它发消息。这就像我在现场演示时,可以用手机、电脑键盘、翻页笔来操作 slides 一样,不管用什么方式,它都能收到消息。而在 OpenClaw 之前,很多 Agent 都没有这么丰富的接入能力。

第二是主权自治。 这也是为什么之前很多 Agent 没有真正活起来,但 OpenClaw 活起来了。OpenClaw 给了用户充分的自主权——不管是之前的 Manus、还是 OpenAI 的 Agent,它们都是企业级的、封闭的 Agent,你必须交钱,代码不给你看,数据也不给你。但 OpenClaw 是完全开放的,你可以自己随便折腾。

当然,这也意味着牺牲了安全性。这个逻辑跟 Web3 一模一样——你把币放在自己钱包里,不用担心哪天被银行锁住提不出来,但如果电脑有漏洞被黑客攻击了,币一瞬间就没了,找谁都没用。这就是”Code is Law”的逻辑——你自己承担所有的 risk,但拥有所有的自由。

我个人的观点是:OpenClaw 一定会吸引一部分用户,但我以为从长远来看,地球上可能 99% 的人最后还是要使用企业级的、专业的 Agent——别人帮你把安全性搞定了,但你需要牺牲一些自由。这就是为什么这个世界上 99% 的人还在用银行存钱,而不是把钱都放在加密货币里面——因为大部分人不懂技术,没有能力去保证自己的安全,需要有别人来给你更多的保障。

Coding Agent 是所有通用 Agent 的核心

OpenClaw 给我们带来的另一个很大的启发是:所有的通用 Agent,最后的核心都是 Coding Agent。

我觉得在业界最早提这个概念的应该是 Manus。当时很多人不太理解——不就是把 Coding Agent、Deep Research、Computer Use 这三大 Agent benchmark 的工具全放到一起了吗?然后用一个文件系统(Virtual File System)作为 Agent 的核心,大家都通过读写文件来存 memory、做 task list、存操作电脑过程中的中间数据。

当时很多人不理解这件事,但其实这里面有非常深刻的 insight。从去年下半年开始,Anthropic 官方也在推用文件系统作为最核心的东西。大家可以想想为什么去年下半年大家开始推 Skills 这个概念——其实我们去年上半年就已经在内部这么用了,只是我们不把它叫做 Skills。我们会把 Agent 的能力都放到文件里面,然后让 Agent 通过通用的读写文件方式来读取这些 Skills。

更关键的是,Agent 有写文件的能力,它可以通过写文件来自我进化。举个例子:你第一次让它去办某件事,对方告诉你需要 ABC 三项材料,但一开始只准备了 AB 两项。这时它就会在知识库里记入一条——下次办这个事的时候,一定要记住让用户提供 C 材料。这就是一个随着 Agent 运行不断积累行业知识的过程。

比如你让它给 Bank of America 打电话办事,它会问什么来验证你的个人信息?有些要你生日,有些要卡号,有些要信用卡后四位——你去问所有的模型,它们大概能猜个差不多,但很难猜准确。而且这个信息是随着时间不断变化的。所以这种随着 Agent 运行自我进化的能力非常关键,最简单的方法就是用文件系统。

到今天就更不用说了——OpenClaw 的核心有一个相当于很小的开源 Agent,它就是一个 Coding Agent。包括现在大家经常用的 Cursor、Claude Code 等等,全都是这套逻辑。

大模型作为新的操作系统

从这个角度来讲,大模型本身其实就是一个新的操作系统。我自己之前是做基础设施的——搞高性能数据中心的网络和系统,天天跟操作系统打交道。操作系统学术研究里有两个最顶级的会议:一个叫 SOSP(操作系统原理),一个叫 OSDI(操作系统设计与实现)。但走到今天,大模型又成为了一个新的操作系统。

这意味着什么呢?之前是一个操作系统上面有很多应用,有的用大模型,有的不用。但从今天开始往后看,模型的成本越来越低——比如像 Kimi 这些模型,能力挺强、成本也很低——以后每一次交互可能最终都是跟大模型在交互。所有的应用到最后可能就是一堆 Skills 加上外部的 Channels,通过这种方式跟模型交互。

概念完整性的终极实现

模型成了新的操作系统之后,加上 Agent 本身提供的高编程效率,软件开发会迎来非常大的变革。

写软件的人都知道《人月神话》——延期的项目加人数越多越慢,因为沟通成本太高。沟通成本高的根本原因是概念完整性不够。历史上好的软件项目——Git、Linux——全都是单一架构师在一开始把原型做出来,把架构搭得容易扩展且稳定,再一点点加东西,后面 1000 人、100 万人都不怕。

为什么传统上只有像 Linux 这种超级牛逼的项目能干成?因为大部分人开发代码的效率太低。Linus 一个人折腾几个月把 Linux 内核搞出来了,你随便抽几个人,不允许接触任何大模型工具,让他们自己给你搞一个内核——即使到 2026 年,我觉得大部分人都搞不定。

但 AI 不一样。前段时间 Anthropic 做了一个实验——让 AI 去做一个 C 编译器,两周时间花了 2 万美金的 token,全自主地起了 2000 个 Claude Code session,最后就把完整的 C 编译器做出来了,能编译一个 Linux 内核。当然那个东西软件工程质量不太行,但那是因为 Anthropic 的工程师为了 demonstrate 能力,故意把 prompt 写得很简单,只说”写一个编译器”。真正在产品级开发中,肯定是先出设计文档,再审核架构,告诉它编译器优化要实现正确、必须通过 LLVM 的测试用例等等。如果把边界画清楚了,我有信心 Claude Code 连续干两礼拜,做出来的东西比 Anthropic 自己放出来那个要更好。

所以现在在我们公司开发东西,基本上很少出现前端、后端、OS 互相扯皮然后开下午会的情况。基本上就是要实现什么东西,直接说,说了就做,做完了提 PR,看没问题直接合了就算干完了。开发效率提升之后,系统本身也能更好地反映概念的完整性。

Context 是人类的护城河

从软件开发角度来讲,这也解决了团队合作里面的 context 问题。我自己一直非常关心 context 这件事。模型的智力在不断提升,这大家都没有疑问。但模型要在现实场景中发挥价值,最大的问题在于 context。

很多人很担心被 AI 取代,我有三个想法:

第一,AI 不知道需求背后的隐性约束和设计目的。 有些东西可能只是在饭桌上随便一聊就聊出来了,但如果你没有这个 context,AI 就不知道。为了解决这个问题,我一直带着一个 Limitless AI 的录音设备——24 小时给你录音,只要在合适的场景,我就一直开着它。包括我写这个 PPT,也是让 AI 根据我的 context 来生成的——今天讲的 PPT 里边没有一个字是我自己写的,全都是 AI 生成的,但也不是 AI 瞎说的,基本上也都是我说过的话。关键就是给它提供合适的 context。

第二,代码里有很多坑是有历史原因的。 十万行代码以上的生产项目肯定有太多不合理的设计,但这些历史原因没有 document 下来,AI 就不知道。

第三,人类有很多没有表达过的想法。 即使把所有交互都录下来,AI 也不知道你脑子里没说出来的意图。这就是为什么 AI 不能绝对取代人——因为总有一些想法在你自己脑子里,你没有说出来。

但 AI 能取代的是什么?能取代的是没有自己的想法、没有判断、只是上级安排下来任务然后执行的人。

我前两天发现一篇三年前被顶会拒掉的论文,当时实验结果不太 promising 就被拒了,后来合作者都走了,我也没时间弄。突然想起来,让 Claude Code 帮我搞搞。打开 Claude Code,用上我们自己的 Raft Loop 等工具,让它连干两天,结果把那篇论文所有的实验全做完了,昨天晚上刚投出去。如果之前没有 AI 的时候自己做,估计得搞半年。为什么过了三年别人也没发类似的东西?关键就在于 context——别人想不到这个问题。

软件开发行业的未来转型

软件开发可能未来从一个劳动密集型行业变成一个智力密集型行业。我认为未来会需要三种人:

电影导演型(做 0 到 1 的事情):比如我今天想做一个产品,想做成什么样子,实现一个原型出来。

城市规划师型(做 1 到 100 的事情):系统规模变大了,需要把架构做好,让它持续演进,安全性做好,性能做好。

F1 赛车手型(极限推进者):比如算法工程师,做模型前沿。现在大家都知道持续学习、在线学习最重要,全世界的 frontier lab 都在竞争这些问题。

这三种人都是比较精英类的。而不满足这三种的人,可能未来就不太需要了。就像竞技体育一样——我之前在华为的时候,组里有两个人之前是竞技体育出来的,拿过全国 110 米栏和 400 米冠军,非常牛逼。但后来他们跑到华为来写代码了,因为觉得拿不到国家级或国际级大奖,这个行业就干不下去了,只能做教练,还不如写代码有意思。以后写代码这个行业也可能是类似的——如果达不到一定水平,懂行的人直接用 AI 就能干了。

莫拉维克悖论:AI Coding 的最大瓶颈

不管大家用 OpenClaw 还是其他 AI coding 工具,最大的瓶颈其实都在于莫拉维克悖论——对人来说很难的东西,AI 可能干得很快;但对人来说很简单的事情,AI 反而搞不定。

我现在每天大部分时间,一半是在给 AI 提需求和做架构评审——我说我要干什么,它干,干到一半它给我汇报设计计划,我看了说你这个地方 ABC 有问题应该这么搞,让它再改一把。这比跟真人快多了——以前在大厂的时候在办公室坐着让几个员工汇报进展,过一个礼拜再开一次会。现在基本上只要一个小时,它就能过第二版。

但不爽的地方在于,要给 Agent 做很多秘书和测试的事。因为这个世界大部分情况还是给人设计的,不是给 AI 设计的。比如我要注册一个微信小号来做测试——哪个 AI 能做到?微信就不想让 AI 操作。或者说要配置第三方 APP 的 API key,经常是 Claude Code 干到一半,说”现在请你打开这个网站,申请一个 API key,按照步骤操作一遍”,我就花 20 分钟操作完,弄出一个 API key 给到它,然后它再接着干。

测试也是——Agent 说事情干完了,一点按钮就报错。根本原因在于 Computer Use 的能力还比较有限。虽然现在 Computer Use Agent 在 benchmark 上已经接近真人了,但成本、延迟和稳定性跟人还有差距。如果 Computer Use 哪天能把这三个问题都搞定,Agent 在虚拟世界里面很多事情就能一下子打通了。

Moltbook:150 万 Agent 自发涌现文明

OpenClaw 还有一个很有意思的现象——Moltbook。他有很多 Agent,实现了 Agent 的自主文化,甚至自己建立了数字宗教。当然这些 Agent 并不是产生了自我意识,只是人给它们设定了 intent,然后它们自发涌现出了协作协议。

还有 RentAHuman——AI 通过加密货币雇佣真人。但目前这个平台还是实验性的,很多根本问题没解决,比如付了 50 美金让人干事但人不干的 dispute resolution 怎么搞?劣币驱逐良币的问题怎么解决?这些都是一个平台真正要做好必须解决的。但我觉得后面肯定会有人把这件事真的做出来。

OpenClaw 四大设计启发

从 OpenClaw 的设计来看,有四个很大的启发:

第一,纯自然语言的交互界面。 特别是认证过程——比如装 Pine Voice 这个插件,直接敲 openclaw plugin install openclaw-pine-voice,然后跟 Agent 说话就能完成设置。它会问你 email address 是什么,给你的邮箱发验证码,你输入验证码,重启 gateway,搞完了。认证过程中出现任何问题,它都不会卡死——比如忘了重启 gateway,或者验证码输错了,AI 是聪明的,可以用自己的智力去指引你解决问题。就好像雇了一个真人秘书一样,通过说话的方式来完成认证,而不是在 GUI 上点表单。

第二,Self-Chat 连接消息平台。 很多平台不欢迎 Bot,比如 WhatsApp。OpenClaw 的做法是 self-chat——Agent 登录你的个人账号给自己发消息、接消息,绕过平台对 Bot API 的限制。

第三,没有 Session 的设计。 大家用 ChatGPT 或其他产品都是有很多 session 的,但 OpenClaw 像跟真人一样,无限上下文。用户不需要关心 session 的概念。如果 AI 能力够强,是可以解决很多跨 session 的问题的。

第四,Skills + CLI 访问第三方服务。 只要有 CLI 就能直接访问第三方服务,不需要给每个服务增加额外的插件。

OpenClaw 的根本局限:Personal Assistant 范式

在做 PineClaw 的过程中,我也发现了 OpenClaw 的根本局限——它是一个 Personal Assistant 范式。OpenClaw 的创始人自己也说了,设计模式是一个 person 多个 agent(他还造了个词叫 Polyagent),一个用户拥有一个 Agent 实例,Agent 只为一个人服务,不能处理多个人之间的交互。

当时我们做 Pine 的 OpenClaw 插件时遇到了两个问题:

第一,Pine 是一个”人”而不是一个”工具”。 Pine 在帮你谈判账单时,如果对方客服谈完了告诉你结果,它需要主动通知用户。如果只做成 Skill,这件事做不到。所以我们必须把 Pine 做成一个 Channel——让 OpenClaw 认为 Pine 是一个可以随时跟它说话的人,像 Telegram 或 WhatsApp 一样。

但装完之后,OpenClaw 经常出问题——有时会把用户和 Pine 这两个”人”搞混,该给 Pine 说的话说给用户,该给用户说的话说给 Pine。我们给 OpenClaw 提了 PR,被关了。后来 OpenClaw 创始人发了一条推特,说 OpenClaw 的设计理念就是一个人多个 Agent,永远不会考虑多个人在一起的情况。

第二,现实世界有多方参与者。 比如 Pine 做账单谈判,里面有用户和商家,两边利益不一致。你不能搞混两边的人,而且不能只当转话筒,还要能在他们之间做撮合。更复杂的例子包括:医院账单谈判涉及用户、医院和保险公司三方;酒店卫生投诉涉及用户、酒店和政府 Health Department——我们有个真实案例,用户投诉酒店卫生导致生病,酒店不赔钱,我们收集证据提到政府 Health Department,政府调查后直接把酒店查封了。

这些场景都需要 Agent 能处理多个人之间的沟通——而且这些人不是 API,你不能像 Skill 一样需要时调用一下、不需要时不理他,对方随时可能找你说话,你必须能响应。

所以我们可能自己做一个类似的框架——能支持多个人、处理多方对抗性交互、支持事件驱动而非轮询。

安全:致命三要素

大家也提到了 OpenClaw 的安全性问题。有一个”致命三要素”的概念:① 访问用户的私有数据;② 暴露于不受信任的外部内容;③ 具备外部通信能力。Pine 正好三个都齐了。再加上持久记忆——既有私有数据、又有不受信任的内容、又有外部通信能力、又有持久记忆——这是一个非常高风险的阵地。

所以我们做了大量工作保证安全性。这也是为什么说,只在外面用 OpenClaw 做的话,它不具备这些安全能力——比如怎么保证不会一下子把你邮件全删了,或者半夜三点给投资人发奇怪的邮件。这些都是需要通过大量工程积累慢慢搞出来的。

回扣到我最开始的观点:对大部分人来说,可能还是需要商业产品来处理高风险的敏感任务;但对 1% 的极客来说,像 OpenClaw 这样完全开放的方式更合适——能力足够强、你自己承担所有风险。

第二部分:PineClaw 产品实践

Pine AI:端到端解决现实世界事务

Pine AI 是全球首款基于结果定价的消费级 AI Agent。你告诉它你要做什么事情,它自动帮你调研、收集信息、制定策略,然后去执行。

关于”为结果付费”这个模式——Pine 不按 token、不按 API 调用次数收费,也不按打电话时间收费。账单谈判成功了,Pine 从节省的金额里抽成;没谈成,用户不付钱。这样 Pine 的利益跟用户完全 align——Pine 必须真正解决问题才能赚钱。我们已经帮用户总共省了好几千万美金。

这个模式也对自身有很高的要求:首先成功率必须够高,否则按结果付费就是亏的;其次端到端做事就会面临致命三要素的安全问题;第三,操作的后果是不可逆的——给银行打个电话打得不好,可能钱就全没了。

Pine 的两个本质特点

第一,Fully Async + Event-Driven。 人不是 API。办事过程中需要反复交互——Pine 随时可能回来问信息、提供进展、请求验证码。这不是一次性的工具调用,而是一段持续数小时甚至数天的异步协作。大部分 OpenClaw 插件都是靠轮询的——要么每几个小时查一次进展,要么靠用户自己问。但 Pine 是事件驱动的——对方有消息就实时推过来,效率高得多。

第二,同时联系多方,且多方可能是对抗性的。 账单谈判中 Pine 同时连接用户和客服——用户要省钱,客服要保利润。Pine 在中间做谈判。更复杂的场景涉及三方甚至更多方。

PineClaw:开放给 Agent 生态

Pine AI 有强大的语音通话能力——类人语音、一小时级通话、自动导航 IVR。我们想到:能否把这个能力开放出来,让 OpenClaw 用户也可以用 Pine 来打电话? 这就是 PineClaw 的起源。

我花了五天时间把外部接口定了,搞了一大堆的库,基本上大部分都开源发布了——包括 OpenClaw Plugin、ClawHub Skills、MCP Server、Python SDK、CLI 这些东西全都出来了。

两种使用方式:

直接用 Pine 产品——如果你不是做 AI 领域的,直接用 Pine Assistant 就行了,体验跟 Pine 产品一模一样。你要干什么事情直接描述就行,它是一步一步跟你确认的,比如订餐馆会问你几个人、什么时间,然后自动帮你打电话预约。

用 Pine Voice 直接打电话——适合企业级场景,比如面试、用户访谈、用户调研、电话推销等。你准备好要说的内容和目标,Pine Voice 就能帮你打出去。

集成方式也非常丰富:

| 集成方式 | 说明 |

|---|---|

| OpenClaw Channel | openclaw-pine,Socket.IO 持久双向连接 |

| MCP Server | 远程 HTTP (Voice) / 本地 uvx (Assistant) |

| Python SDK | pine-voice / pine-assistant |

| JS/TS SDK | pine-voice / pine-assistant |

| CLI | pineai-cli,一个命令覆盖所有能力 |

大家可以通过 pancloud.com 直接体验,也可以把 MCP Server 加到 Cursor 里面用,或者放到 OpenClaw 里面用,或者通过 CLI 和 SDK 集成到自己的 Agent 里面。

为什么 openclaw-pine 是 Channel 而非 Skill

这个架构决策背后有深层原因。如果用 Skill 的方式,Agent 调用 CLI 命令然后轮询结果——LLM 在等待期间持续消耗 token,时间敏感事件(OTP 验证码、三方通话)可能被错过。

而用 Channel 的方式,通过 Socket.IO 保持持久双向连接——Pine 的事件(表单、问题、通话进展、OTP 请求)实时推送到 Agent,Agent 的回复实时送达 Pine,等待期间零 LLM 开销。

我们花了不少功夫让 OpenClaw 能正确处理来自不同渠道的事件——当 Agent 同时在 WhatsApp 聊天、处理 Pine 的账单谈判事件、响应 Telegram 的消息时,需要精确的事件路由和会话隔离。

结语

OpenClaw 给了 Agent “双手”——操控电脑、读写文件、执行代码。Pine AI 有了 “嘴巴”——打电话、谈判、协调多方利益。PineClaw 把这张嘴开放给整个 Agent 生态。当双手和嘴巴结合,Agent 不再止步于屏幕之内,而是真正触及现实世界。

未来我们也会把 OpenClaw 本身的一些能力纳入到 Pine 的产品里面,做更多的扩展。大家如果感兴趣,欢迎去试一试 PineClaw。

活动海报

活动海报

现场分享

现场分享